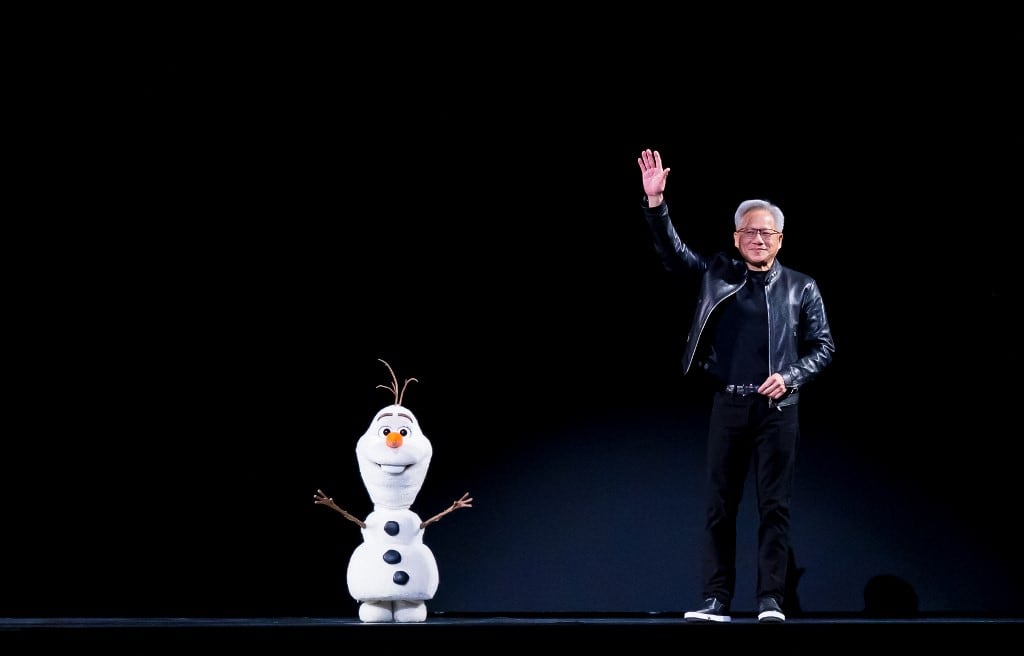

En el mundo de la tecnología, pocos eventos se esperan con tanto interés como el discurso de Jensen Huang en la conferencia anual de desarrolladores de Nvidia. Y en el evento de este año, celebrado en San José el 16 de marzo, su intervención no decepcionó.

Durante más de dos horas, el director de la empresa más valiosa del mundo presentó nuevos chips, modelos de inteligencia artificial y sistemas para todo, desde centros de datos espaciales hasta vehículos autónomos. Continuó afirmando que esta gama de nuevos productos ayudará a Nvidia a vender más de US$ 1 billón en hardware relacionado con la IA en los próximos años.

Entre los ingenieros, la reacción fue entusiasta. Entre los inversionistas, fue más cautelosa. Han aumentado las dudas sobre la durabilidad del auge de la IA. Y Nvidia, la mayor beneficiaria del aumento del gasto, se ha convertido en el blanco de esas preocupaciones. El 25 de febrero, la empresa reportó ganancias trimestrales récord y pronosticó un fuerte crecimiento.

Sin embargo, el precio de sus acciones cayó al día siguiente. Desde que alcanzó su punto máximo en octubre, ha bajado alrededor de un 10%, incluso cuando un índice de fabricantes de chips estadounidenses ha subido alrededor de un 8%. Este pesimismo marca un cambio en la suerte de Nvidia.

LEA TAMBIÉN: Nvidia proyecta ingresos de al menos US$1 billón hacia 2027 impulsados por la IA

El ascenso de la empresa ha sido extraordinario incluso para los estándares de Silicon Valley. Sus unidades de procesamiento gráfico (GPU), los semiconductores que hacen el trabajo pesado en los modelos de IA, representan más de dos tercios de la potencia de procesamiento total disponible en los chips de IA del mundo.

En el año hasta enero, la empresa generó US$ 216,000 millones en ingresos, ocho veces más de lo que ganó tres años antes. Los ingresos netos se multiplicaron casi por 30, hasta alcanzar los US$ 120,000 millones. Nvidia tardó casi tres décadas en alcanzar un valor de mercado de US$ 1 billón; apenas dos años después, se disparó a 4 billones. Cuatro meses después de eso, superó brevemente los US$ 5 billones.

¿Hasta dónde puede llegar Nvidia? Mucho más alto, si le creemos a Huang. Él ha afirmado que los cientos de miles de millones de dólares gastados hasta ahora en infraestructura de IA son solo el comienzo y que le seguirán “billones” más. Es más, Nvidia cuenta con los recursos para beneficiarse. Sus flujos de caja operativos se equiparan a los de los otros gigantes tecnológicos. La empresa cuenta con más de US$ 62,000 millones en efectivo, un tercio de los cuales se generó en el último año.

Para aprovechar la oportunidad, Huang planea convertir a Nvidia en una “empresa fundamental” sobre la que se asiente la economía de la IA. Eso significa vender diferentes tipos de chips y hardware, agrupar productos en sistemas completos de IA e integrar la tecnología de Nvidia más profundamente en diferentes industrias.

En resumen, Nvidia se está convirtiendo en mucho más que un fabricante de chips de IA.

Tras el rey

La transformación es necesaria en parte porque el éxito de Nvidia ha atraído a competidores. Algunos son rivales tradicionales, como AMD, un fabricante de chips estadounidense que ha lanzado alternativas decentes a las GPU de Nvidia. Otros son empresas emergentes que buscan oportunidades.

Los nuevos diseños de chips se están volviendo comercialmente viables porque la necesidad de inferencia (modelos de IA que responden consultas) está creciendo, y el proceso impone un conjunto de exigencias a los chips diferente al del entrenamiento.

Según PitchBook, una empresa de datos, las nuevas empresas de chips recaudaron US$ 17,000 millones en 2025, más que en los dos años anteriores juntos. Sin embargo, los rivales más formidables son los propios clientes de Nvidia.

LEA TAMBIÉN: Jensen Huang inaugura el “Super Bowl de la IA” con proyecciones récord para Nvidia

Los hiperescaladores —Alphabet, Amazon, Microsoft y Meta—, todos los cuales dependen de un gran número de centros de datos para operar sus negocios, compran enormes cantidades de sus chips. En el último ejercicio financiero, solo tres de estos hiperescaladores representaron más de la mitad de las cuentas por cobrar de Nvidia, dinero adeudado pero aún no pagado.

Sin embargo, estas mismas empresas también están diseñando sus propios procesadores. Esto puede reducir el costo de los chips de IA a más de la mitad, al tiempo que se obtiene un mejor rendimiento al adaptar el hardware al software que se ejecuta en él. El deterioro de la situación geopolítica ha animado a los rivales en el extranjero. Desde octubre de 2022, el gobierno de Estados Unidos ha prohibido a Nvidia vender sus chips más avanzados a China. Las ventas se han ralentizado de manera drástica.

Bernstein, una empresa de investigación, estima que los proveedores locales como Huawei, Cambricon y MetaX podrían crecer desde menos de una quinta parte del mercado chino de chips de IA en 2023 a más de nueve décimas para 2027. Jay Goldberg, de Seaport Research Partners, un analista del sector, señala que la amenaza podría extenderse más allá de China. Puede que los nuevos rivales no fabriquen chips tan potentes como los de Nvidia, pero en algunos mercados “suficientemente buenos” podría resultar suficiente.

Todo, en todas partes, al mismo tiempo

La respuesta de Nvidia es expandirse en todas las direcciones. Huang ha comparado la industria de la IA con un “pastel de cinco pisos”: energía, chips, infraestructura de red, modelos y aplicaciones. Nvidia pretende hacerse con tres de los cinco pisos. Tras haber conquistado el mercado de las GPU, la empresa planea vender diferentes tipos de chips.

En diciembre, Nvidia pagó US$ 20,000 millones para adquirir la licencia de la tecnología y contratar a ingenieros de Groq, una empresa emergente especializada en chips de inferencia. El 16 de marzo, la empresa presentó un nuevo chip que utiliza la tecnología de la empresa emergente. También está entrando en el mercado de las unidades centrales de procesamiento (CPU), un tipo de chip de uso general.

Se trata de un área dominada desde hace tiempo por Intel, un gigante en apuros. Nvidia ya fabrica CPU utilizando diseños de Arm, una empresa británica, que se utilizan en sus servidores de IA. Ahora planea venderlas de manera más amplia. En febrero, Nvidia llegó a un acuerdo con Meta para suministrar servidores que solo utilizan CPU. Nvidia también está invirtiendo en otras áreas.

A medida que los sistemas de IA crecen, el traslado de datos entre procesadores se ha vuelto tan importante como los procesadores. La empresa está apostando fuertemente por los equipos de red, la tecnología que conecta los chips entre sí. En su último trimestre, este negocio generó US$ 11,000 millones en ingresos, lo que convierte a Nvidia en uno de los principales participantes del sector.

La creación de modelos es el tercer piso. Nvidia ha lanzado varias familias de modelos de IA de código abierto. Estos son especializados y están dirigidos a industrias específicas. Entre ellos se incluyen Alpamayo para vehículos autónomos, GR00T para robótica y BioNeMo para investigación biomédica. A menudo ocupan los primeros puestos en las clasificaciones de IA de código abierto.

Nvidia planea invertir miles de millones para expandir sus capacidades en este piso del pastel, con un enfoque en modelos adaptados a aplicaciones específicas. Una de las razones para poseer todo “de extremo a extremo”, una frase que se usa en Silicon Valley para denominar la integración vertical, es que facilita la coordinación de las diferentes capas.

Al vincular estrechamente los chips, el equipo de los centros de datos y los modelos, la empresa afirma que puede obtener un mejor rendimiento que si optimizara cada parte por separado. Huang ha comparado la construcción de sistemas de IA sin integración con conectar “demasiados gatos y perros”. Esto también significa que Nvidia puede vender su hardware en paquetes.

Cada vez más, la empresa describe sus productos no como chips, sino como componentes de “fábricas de IA”, su término para referirse a los centros de datos especializados en IA. Algunas de estas fábricas se están vendiendo directamente a los gobiernos bajo la bandera de la “IA soberana”, la etiqueta que designa los esfuerzos liderados por el Estado para construir infraestructura nacional de IA.

Los ingresos por IA soberana se triplicaron el año fiscal pasado a más de US$ 30,000 millones, alrededor del 15% de las ventas de IA de Nvidia. La empresa también está tratando de depender menos de los hiperescaladores que dominan su lista de clientes. Un enfoque consiste en adentrarse más en la industria.

En la fabricación de automóviles, Mercedes-Benz pronto comercializará vehículos equipados con los sistemas de conducción autónoma de Nvidia. En el sector farmacéutico, Eli Lilly utiliza la infraestructura y los modelos de Nvidia para acelerar el descubrimiento de fármacos.

Dion Harris, ejecutivo de Nvidia, afirma que el objetivo es trabajar más de cerca con los clientes finales, como Lilly y Mercedes, para comprender sus necesidades y dar forma a la próxima ola de computación de IA. Pero Nvidia no es la única que dice estar trabajando en estrecha colaboración con los clientes.

Tales movimientos ponen a la empresa en curso de colisión con los hiperescaladores, que ofrecen servicios similares. Otro enfoque consiste en crear demanda a través de sus inversionistas. La idea es que las empresas respaldadas por Nvidia sean más propensas a comprar sus chips.

Por ello, el fabricante de chips es ahora uno de los inversores más prolíficos de Silicon Valley. Desde 2020 ha realizado 250 inversiones, comprometiendo más de US$ 65,000 millones. Esto incluye apuestas tan grandes como una inversión de US$ 30,000 millones en OpenAI, así como otras más pequeñas en empresas emergentes de robótica, software y aplicaciones de IA. Las inversiones de la empresa también ayudan a asegurar su cadena de suministro.

Este mes de marzo, Nvidia invirtió más de US$ 4,000 millones en empresas que desarrollan interconexiones ópticas, que utilizan la luz para transferir datos en lugar de cables. La mayoría de los centros de datos de IA siguen dependiendo de cables de cobre para conectar sus equipos. La apuesta de Nvidia sugiere que espera que las conexiones ópticas cobren cada vez más importancia.

Ben Bajarin, de la consultora Creative Strategies, compara la estrategia con las primeras medidas de Apple para acaparar componentes para el iPod. Nvidia está utilizando su reserva de efectivo para fortalecer otras partes de su cadena de suministro. La industria de los semiconductores es propensa a la escasez cuando la demanda se dispara. Los suministros de memoria avanzada — fundamental para los chips de IA— ya están agotados para este año y gran parte del próximo.

Nvidia compró con mucha antelación la mayor parte de la memoria que necesitará este año y parte del próximo. Nada de esto garantiza el dominio continuado de Nvidia. Sus rivales podrían erosionar sus márgenes. El cambio de la industria, que pasa de entrenar modelos a ejecutarlos, podría favorecer a los chips de otros proveedores. Y si el gasto en IA se enfría, las ventas podrían ralentizarse drásticamente. Pero, por ahora, el campeón de la era de la IA sigue siendo dominante y parece decidido a expandir su imperio.